Створення системи стримувань і противаг для систем штучного інтелекту – завдання для соціальних служб і політологів.

Одним із тривалих наслідків пандемії Covid-19 стало зниження довіри до експертів та установ охорони здоров’я. Неважко зрозуміти чому: Америка провалила тестування на Covid, занадто довго тримала школи закритими, не змогла достатньо швидко вакцинувати достатньо людей і завдала набагато більшої економічної шкоди, ніж було необхідно — і через усе це експерти з охорони здоров’я часто мав домінуючий голос.

На свій захист посадові особи громадської охорони здоров’я навчені ставити громадську безпеку понад усе. І до їхньої честі, багато хто зараз визнає, що будь-яка відповідь на кризу громадського здоров’я повинна враховувати компроміси, властиві будь-якому втручанню. Як нещодавно сказав доктор Ентоні Фаучі New York Times, «я не економіст».

Як це сталося? І я боюся, що ми знову припустимося тієї ж помилки — тобто довіримося не тим експертам — зі штучним інтелектом.

Деякі з найбільших умів у цій галузі, такі як Джеффрі Хінтон, виступають проти розробок ШІ та закликають призупинити дослідження ШІ. Раніше цього тижня Хінтон залишив роботу в галузі штучного інтелекту в Google, заявивши, що він стурбований дезінформацією, масовим безробіттям і майбутніми ризиками більш руйнівного характеру. До речі, з розмов з людьми, які працюють на передовій ШІ, я знаю, що багато інших дослідників також стурбовані.

Але чого я не чую, так це більш систематичного аналізу витрат і вигод прогресу ШІ. Такий аналіз мав би розглянути, як штучний інтелект міг би запобігти іншим екзистенційним ризикам — наприклад, відвернення астероїда, що наближається, або розробка кращих засобів проти зміни клімату — або як штучний інтелект міг би вилікувати рак чи іншим чином покращити наше здоров’я. І ці аналізи часто не враховують ризики для Америки та світу, якщо ми зупинимо розробку ШІ.

Я також не чую особливого залучення до економічних аргументів про те, що, незважаючи на те, що перехід на ринок праці коштує дорого, вивільнення робочої сили було одним із основних способів матеріального прогресу протягом всієї історії. Економіка США вже має вражаючий ступінь автоматизації, не лише завдяки штучному інтелекту, і наразі працює на повну зайнятість. У разі потреби уряд міг би поширити соціальний захист на працівників перехідного періоду, а не зупиняти працезберігаючі інновації.

Кожна з цих тем настільки складна, що простих відповідей немає (навіть якщо ми запитаємо ШІ!). І все-таки в цій складності лежить урок: справжня експертиза ширших наслідків штучного інтелекту належить не самим експертам зі штучного інтелекту. У всякому разі, зауваження Хінтона про вплив штучного інтелекту на безробіття — « це позбавляє від важкої роботи», — сказав він, і «може позбавити цього більше» — змушує мене погіршити його судження.

Проте Хінтон визнано найважливішою фігурою, яка стоїть за останніми розробками нейронних мереж штучного інтелекту, і він отримав еквівалент Нобелівської премії у своїй галузі. І він тепер сумнівається, чи варто було йому взагалі проводити дослідження. Хто я такий, щоб сумніватися в його висновках?

Щоб було зрозуміло, я не ставлю під сумнів ні його наміри, ні його досвід. Але я б поставив інше запитання: хто сьогодні є експертом у моделюванні того, як різні системи штучного інтелекту взаємодіятимуть одна з одною, створюючи стримування та противаги, подібно до того, як це роблять децентралізовані людські інституції? Ці аналізи не є дуже далекими, а тим більше перевіряються на основі даних. Їм знадобиться глибоке розуміння соціальних і політичних наук, а не лише штучного інтелекту та інформатики, і неочевидно, хто саме здатний здійснити такий синтез — особливо в епоху гіперспеціалістів.

Майже само собою зрозуміло, що існують різні види експертизи. Фахівці з національної безпеки, наприклад, постійно стикаються з небезпечними ризиками для Америки, і вони повинні виробити синтетичне розуміння того, як реагувати. Скільки з них звільнилися з установи, щоб стати AI Cassandras? Я не бачив потоку протестів, і це люди, які вивчали, як деструктивні дії можуть посилюватися через ширший соціальний та економічний порядок. Можливо, вони звикли до думки, що серйозні ризики завжди з нами.

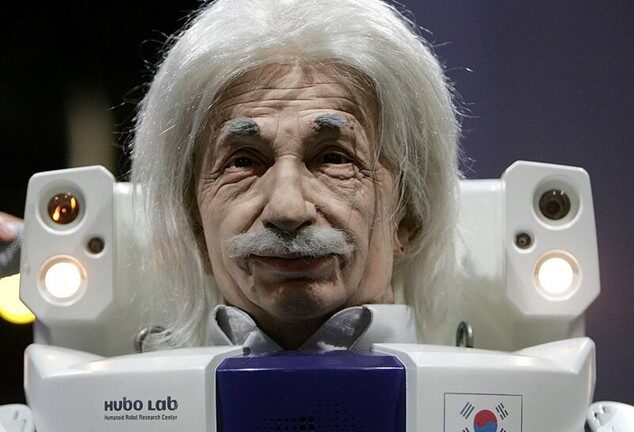

Альберт Ейнштейн допоміг створити основу для мобілізації ядерної енергії, а в 1939 році він написав президенту Франкліну Рузвельту, закликаючи його створити ядерну зброю. Пізніше він відрікся, сказавши в 1954 році, що світ був би кращим без них. Можливо, він ще доведено, що він правий, але наразі більшість американців вважають компроміси прийнятними, частково тому, що вони створили еру гегемонії США та гарантували, що лідери США не можуть легко уникнути витрат великих воєн. Ядерне роззброєння все ще існує як рух, але його не підтримує жодна велика політична партія жодної ядерної країни. (У всякому разі, Україна шкодує, що відмовилася від ядерної зброї.)

Урок очевидний: експерти з інших галузей часто виявляються правильнішими, ніж експерти у «релевантній» (навмисні лапки) галузі — із застереженням, як показують Ейнштейни 1939 та 1954 років, що всі такі судження є тимчасовими.

Що стосується штучного інтелекту, як і з багатьма проблемами, погляди людей зазвичай базуються на їхніх попередніх думках хоча б тому, що їм більше нікуди звернутися. Тож я заявляю: децентралізовані соціальні системи досить надійні; світ пережив деякі серйозні технологічні потрясіння в минулому; національне суперництво завжди буде з нами (отже, потреба випередити Китай); а інтелектуали можуть надто легко вмовити себе на загибель.

Усе це спонукає мене до переконання, що найкращий спосіб створити безпеку — це створювати та вирішувати проблеми на цьому шляху, іноді навіть поспішно, а не вести абстрактні дискусії в Інтернеті.

Тож я відносно прихильно ставлюся до розвитку ШІ. Я скептично ставлюся до аргументів, які, якщо їх застосовувати послідовно, також завадили б розвитку друкарського верстата чи електрики.

Я також вважаю, що інтелект аж ніяк не є домінуючим фактором у суспільних справах і що він є багатовимірним до крайності. Тож навіть дуже вражаючий штучний інтелект, ймовірно, не матиме всіх необхідних навичок, щоб знищити або поневолити нас. Ми також схильні антропоморфізувати нерозумні сутності та приписувати ворожі наміри там, де їх немає.

Багато критиків ШІ, як не дивно, не поділяють мої попередні думки. Вони вважають координацію майбутніх ШІ відносно простою; уникнення ризику та крихкість як першочергові; і потенційно конкуруючі інтелекти як небезпечні для людей. Вони применшують конкуренцію між країнами, наприклад, з Китаєм, і мають більш позитивний погляд на те, чого може досягти регулювання ШІ. Деякі є крайніми раціоналістами, цінуючи ідею чистого інтелекту, і тому вони бачать майбутнє штучного інтелекту більш загрозливим, ніж я.

Тож хто саме є експертами в обговоренні того, який набір пріоритетів є більш реалістичним чи корисним? Я визнаю, що це питання не зовсім дає відповідь, але воно також не має значення. Тому що дебати щодо штучного інтелекту, коли справа доходить до них, все ще здебільшого стосуються попередніх. Принаймні, коли економісти обговорюють наслідки мінімальної заробітної плати, ми використовуємо широко співмірні моделі та емпіричні дослідження. Дебати щодо штучного інтелекту не наближаються до такого рівня суворості.

Незалежно від того, як триватимуть дебати, неможливо обійти справжню моральну дилему, яку виявив Хінтон. Припустімо, ви зробили внесок у технологічний або соціальний прогрес, який мав значні наслідки, а співвідношення вигод і витрат становило 3 до 1. Чистий прибуток був би дуже високим, але й (валові) витрати також. І ці витрати будуть накладені через вашу працю.

Як легко ви спали б, знаючи, що ваша робота, якою ви давно справедливо пишалися, призвела до такої кількості кібератак, втрати роботи та страждань? Чи полегшить вам відчуття компенсації? Що, якби співвідношення вигод і витрат було 10 до 1? Як щодо 1,2 до 1?

На ці глибоко нормативні питання немає об’єктивних відповідей. Те, як ви реагуєте, ймовірно, залежить від вашого типу особистості. Але питання про те, як ви ставитеся до своєї роботи, не збігається з тим, як вона впливає на суспільство та економіку. Прогрес не повинен відчуватися, як робота в сортувальній палаті, але іноді це так.

Автор: Тайлер Коуен (Tyler Cowen) – оглядач Bloomberg Opinion. Він є професором економіки в Університеті Джорджа Мейсона та пише для блогу Marginal Revolution.

Джерело: Bloomberg